Soczewki niedoskonałe

Jak dotąd sprowadzaliśmy sobie obiektyw do pojedynczej soczewki i zakładaliśmy, że wszystko jest idealnie. Niestety ideały w przyrodzie nie występują. Próba fotografowania pojedynczą soczewką da obraz nieostry i zniekształcony. Dzisiejszy artykuł będzie o tym jakie wady mają układy optyczne (choć to w formie skróconej bo Internet tego pełny) i co da się z tym zrobić.

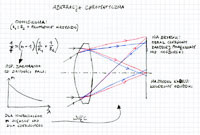

Wady układów optycznych nazwano aberracjami optycznymi i podzielono na rodzaje. Mamy więc aberrację chromatyczną, która wynika z faktu, że współczynnik załamania szkła nie jest taki sam dla wszystkich kolorów światła, a o której napiszę trochę w osobnym tekście. Pozostałe aberracje nazywane są aberracjami monochromatycznymi i wynikają z kształtu soczewek. Wśród nich są: wada polegająca na tym, że jeżeli soczewka ma powierzchnie będące wycinkami sfer, to brzegi soczewki mają krótszą ogniskową, niż jej środek.;

Astygmatyzm i koma, które w obiektywach fotograficznych występują tylko poza środkiem kadru, i które wyjaśnię w następnym odcinku;

Dystorsja, powodująca, że jeżeli fotografujemy proste linie, to wyjdą wprawdzie ostre, ale powykrzywiane.]I wreszcie jest krzywizna pola obrazowego polegająca na tym, że aby nastawić ostrość na całą płaską ścianę ustawioną prostopadle do osi obiektywu musielibyśmy wybrzuszyć powierzchnię sensora, bo jak jest płaski to się nie da. Jest jeszcze winietowanie, którego nie zalicza się do aberracji optycznych, ale się koryguje, a które polega na tym, że obraz na środku kadru jest jaśniejszy niż na brzegach.

Co można z tym zrobić?

Pierwszym naturalnym sposobem jest przymknięcie przysłony. Oprócz dystorsji i tzw. aberracji chromatycznej poprzecznej, wszystkie wady optyczne maleją wraz ze zmniejszaniem średnicy źrenicy wejściowej. Z tego wynikają dwa wnioski. Po pierwsze, jeżeli obiektyw ma osiągać określoną rozdzielczość, to zaprojektowanie go jest trudniejsze, jeżeli dodatkowo ma być jasny (bo jest więcej wad do skorygowania). Po drugie, dopóki obiektyw nie działa jak obiektyw idealny, dopóty przymykanie przysłony będzie poprawiać ostrość obrazu. Tylko...

co to znaczy "obiektyw idealny"

...i jaką ma on rozdzielczość?

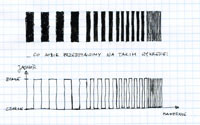

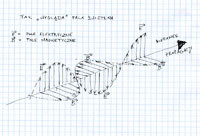

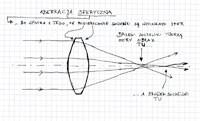

Światło, oprócz tego, że jest strumieniem cząstek zwanych fotonami, jest także falą. A jednym z podstawowych zjawisk, jakim podlegają fale jest dyfrakcja. Słowo to mogliście poznać przy okazji szkolnego doświadczenia, w którym przepuszczano promień światła przez szczelinę, w wyniku czego pojawiały się prążki - centralny najsilniejszy i kolejne boczne coraz słabsze. A im węższa była szczelina, tym prążek centralny był szerszy, a odległość pomiędzy sąsiednimi prążkami większa. Przysłona w obiektywie fotograficznym działa bardzo podobnie. W efekcie, jeżeli weźmiemy nawet nieskończenie drogi obiektyw, w którym wszystkie wady optyczne są kompletnie wyeliminowane i sfotografujemy mały jasny punkt na ciemnym tle, to jego obraz nie będzie wcale punktem, tylko będzie wyglądał mniej więcej tak:

Źrenica obiektywu różni się od szczeliny ze szkoły tym, że jest okrągła. Z tego powodu zamiast prostych, równoległych prążków dostaniemy okrągłą kropkę w środku i serię koncentrycznych krążków dookoła. Taki obraz nazywa się plamką Airy'ego.

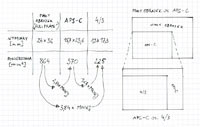

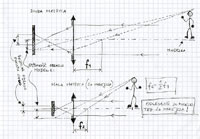

W takiej sytuacji rozdzielczość obrazu nie będzie już limitowana wadami optycznymi, tylko dyfrakcją na krawędziach przysłony. A jaka to będzie rozdzielczość? Załóżmy, że fotografujemy dwa jasne punkty na ciemnym tle zamiast jednego. Pytanie o rozdzielczość obrazu to pytanie, jak blisko siebie mogą się te punkty znaleźć, aby nie zlały nam się w jeden. No to sobie rysujemy obrazy dyfrakcyjne dwóch punktów blisko siebie:

Okazuje się, że rozdzielczość najlepszego obiektywu (a więc pracującego w reżimie dyfrakcyjnym) zależy tylko od trzech rzeczy: długości fali światła, liczby przysłony obiektywu i tego jak płytkie może być minimum pomiędzy dwoma pikami abyśmy jeszcze mogli to zobaczyć jako dwa piki, a nie jeden (od tego zależy to, co na rysunku oznaczyłem jako COŚ). Najczęściej w przypadku optyki ograniczonej dyfrakcyjnie uznaje się, że dwa punkty możemy jeszcze rozróżnić, gdy jeden leży w pierwszym minimum drugiego, a więc tak, jak narysowałem. To kryterium nazywa się Kryterium Rayleigha i jeżeli je zastosujemy, to wyjdzie, że COŚ=1,22.

Dostajemy zatem sytuację, w której przymykając przysłonę POGARSZAMY rozdzielczość obiektywu. Czyli dokładnie odwrotnie, niż pisałem na początku! Co więcej oznacza to też, że choć jaśniejszy obiektyw zaprojektować jest trudniej, to jednak da się go skorygować lepiej, niż ciemny. Wreszcie warto wiedzieć, że taki idealny obiektyw ma znacznie lepszą rozdzielczość dla obrazów niebieskich i fioletowych, niż dla czerwonych (długość fali we wzorze!).

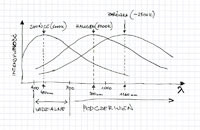

Problem fotografa polega na tym, że chyba żaden obiektyw fotograficzny NIE JEST tak dobry, aby przy w pełni otwartej przysłonie pracował w reżimie dyfrakcyjnym. Z drugiej strony prawie wszystkie w miarę domykania przysłony osiągają ten limit. Znaczy to tyle, że gdy przymykamy przysłonę ostrość obrazu najpierw rośnie (bo redukujemy aberracje), osiąga jakieś maksimum, po czym zaczyna spadać z powodu dyfrakcji. Ta najlepsza przysłona jest zazwyczaj w okolicach f5,6 lub f/8 , ale może być odrobinę różna dla różnych obiektywów. I warto wiedzieć jaka jest dla obiektywu, którego używamy.

O kryteriach rozdzielczości.

Na koniec proponuję coś, o czym warto pamiętać, gdy czytamy testy obiektywów. W testach czytamy bowiem "ten obiektyw ma rozdzielczość 120 l/mm". Co to znaczy? Otóż tak długo, jak tester nie powie co oznacza, że dwie linie jeszcze widzi jako dwie, to NIC nie znaczy.

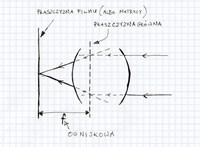

Na czym polega problem? Obrazy dwóch ostrych linii będących coraz bliżej siebie mają mniej więcej taką intensywność.

Jak linie zaczynają się zbliżać, to minimum pomiędzy dwoma maksimami robi się coraz płytsze. Inaczej mówiąc, gdy gęstość linii zbliża się do ograniczeń optyki, obraz tych linii zaczyna mieć coraz mniejszy kontrast. Aby określić ile linii/mm obiektyw jest w stanie odwzorować musimy najpierw zdecydować się jak mały kontrast jeszcze widzimy. Problem w tym, że takich kryteriów jest całkiem sporo i różnią się całkiem bardzo. Dość powiedzieć, że wszystkie powyższe obrazki pokazują graniczne sytuacje wyznaczania rozdzielczości po przyjęciu różnych kryteriów.

Jest opisane wyżej kryterium Rayleigha, które, gdyby je przetłumaczyć na przenoszenie kontrastu, oznacza, że kontrast ma spaść nie bardziej niż do 9% tego, co dla bardzo szerokich linii. Ale wielu testerów fotograficznych uważa, że to bardzo słabo widoczne paski i ustalają granicę nie na 9% kontrastu, tylko na 50% (co nazywają często kryterium "MTF50").

Z drugiej strony na przykład pan Sparrow uznał, że on może widzieć linie, jeżeli w ich obrazie jest jeszcze jakikolwiek kontrast, czyli za granicę uznał sytuację, gdy pomiędzy dwoma maksimami nie ma już w ogóle minimum czyli granicę postawił na 0% kontrastu.

Nie trzeba mówić, że mając ten sam obiektyw, nawet to samo zdjęcie tablicy testowej przyjęcie kryterium MTF50 da dużo niższy wynik rozdzielczości, niż np. kryterium Rayleigha

_1094526942.jpg)

_443908423.jpg)

_1877607562.jpg)

_968856305.jpg)